Ο πόλεμος στην Ουκρανία χαρακτηρίζεται από πολλούς ως ο πόλεμος των drones. Η τεχνητή νοημοσύνη και η χρήση νέων τεχνολογιών θα μπορούσαν να καθορίσουν τις εξελίξεις στα πεδία των μαχών, ενώ ήδη φαίνεται πως βρισκόμαστε στη χαραυγή των αυτόνομων οπλικών συστημάτων, των γνωστών ως Killer Robots.

Αναλυτές, στρατιωτικοί αξιωματούχοι και ειδικοί εκτιμούν πως σύντομα θα δούμε σε πλήρη δράση μηχανές που αναγνωρίζουν, επιλέγουν και εξουδετερώνουν έναν στόχο χωρίς καμία ανθρώπινη παρέμβαση. Όπως ανέφερε το Associated Press, σε παλαιότερο δημοσίευμά του, κάτι τέτοιο θα συνιστούσε μια επανάσταση στην στρατιωτική τεχνολογία αντίστοιχη με αυτή που έφερε η εφεύρεση του πολυβόλου.

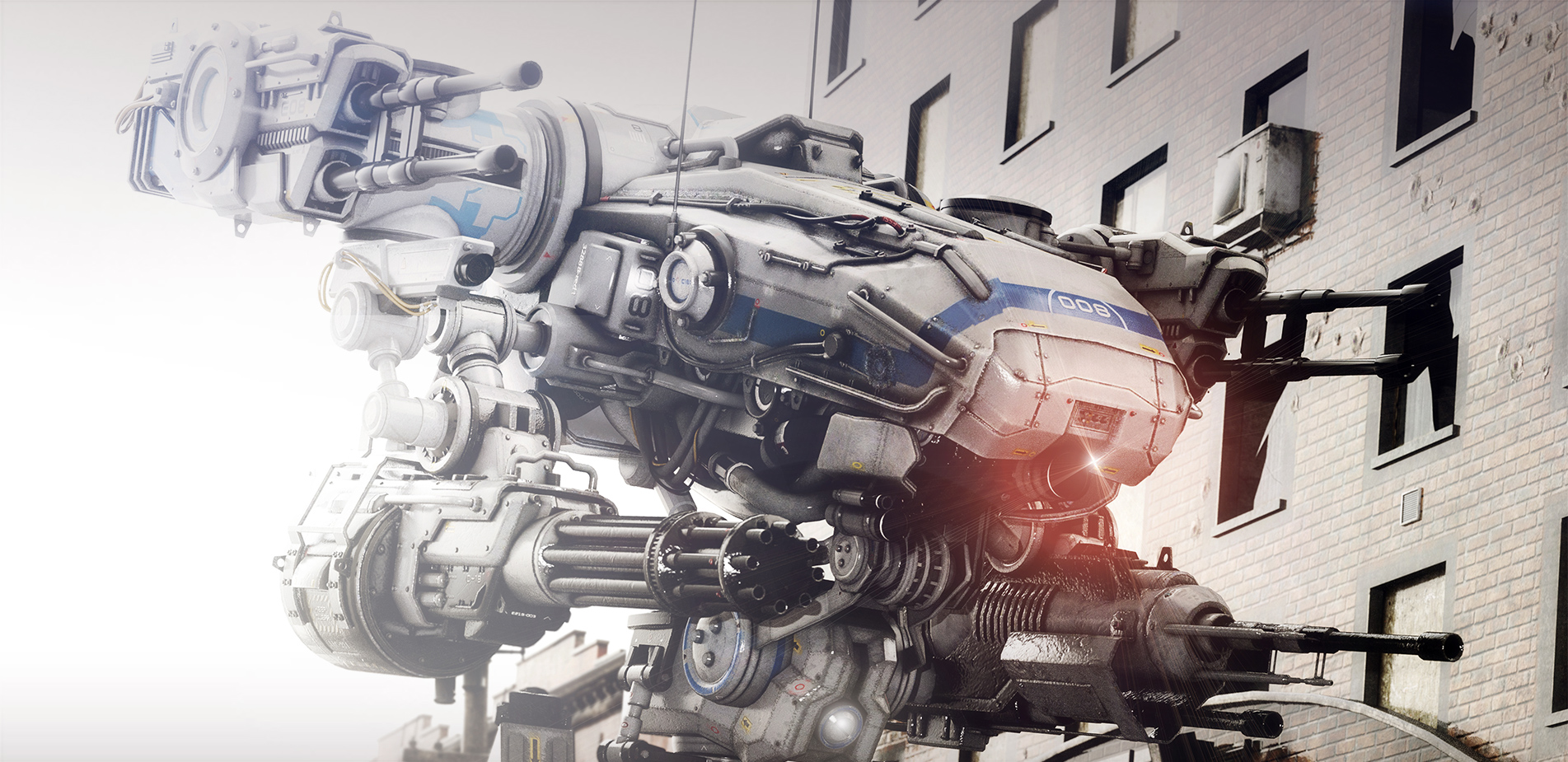

Η τεχνολογία φαίνεται πως υπάρχει ήδη και το μόνο ερώτημα που μένει να απαντηθεί είναι το πότε θα αποφασιστεί να «ριχτεί» στα πεδία των μαχών. Φανταστείτε drones – καμικάζι ή τροχοφόρα ρομπότ, εξοπλισμένα με σύγχρονα όπλα, που πραγματοποιούν φονικές επιθέσεις, κλειδώνοντας τον στόχο και ανοίγοντας πυρ λαμβάνοντας «εντολή» αποκλειστικά από τον αλγόριθμό τους, καθώς η τεχνητή νοημοσύνη θα καθιστούσε περιττό τον άνθρωπο χειριστή.

Οι ΗΠΑ, η Ρωσία, η Κίνα και πολλές ακόμα χώρες, μεταξύ αυτών και ευρωπαϊκές, αναπτύσσουν τέτοιου είδους οπλικά συστήματα, όπως τα αυτόνομα μη επανδρωμένα αεροσκάφη που έχουν τη δυνατότητα να επιτίθενται ως φονικό σμήνος. Το Iron Dome, η περιβόητη αντιπυραυλική ασπίδα του Ισραήλ, είναι επίσης ένα από τα πολλά ενεργά αμυντικά συστήματα που λειτουργούν χωρίς ανθρώπινη επίβλεψη. Οι μελλοντικοί πόλεμοι θα μπορούσαν να είναι σύγκρουση μέχρι πτώσης και του τελευταίου ρομπότ. Ο πρόεδρος της Ρωσίας, Βλαντιμίρ Πούτιν, το 2017 κατά τη διάρκεια μιας συνάντησης με φοιτητές μηχανικής, είχε προβλέψει με γλαφυρότητα: «Όταν τα drones της μίας πλευράς καταστραφούν από τα drones της άλλης, δεν θα υπάρχει άλλη επιλογή από την παράδοση».

Η ρομποτική αλληλοεξόντωση είναι ένα ενδεχόμενο σενάριο. Εξάλλου οι υποστηρικτές των Killer Robots υποστηρίζουν ότι με την τεχνολογία οι στρατιώτες μένουν μακριά από τους φονικούς κινδύνους των μαχών, ενώ η λήψη στρατιωτικών αποφάσεων γίνεται με μεγαλύτερη ταχύτητα, προσφέροντας ριζικά βελτιωμένες αμυντικές ικανότητες.

Φονικές μηχανές χωρίς έλεγχο

Τι συμβαίνει όμως όταν τα «ρομπότ δολοφόνοι» βάζουν στο στόχαστρο τους ανθρώπους. Το τελευταία διάστημα με την αυξανόμενη χρήση της τεχνητής νοημοσύνης έχουν γίνει αντιληπτές οι τεράστιες δυνατότητές της, που σε πολλές περιπτώσεις ξεπερνούν τον άνθρωπο. Όμως έχουμε γίνει και μάρτυρες των «λαθών» των αλγορίθμων. Στον πόλεμο τα λάθη είναι μοιραία και κοστίζουν ανθρώπινες ζωές. Και οι μηχανές δεν μπορούν να λογοδοτήσουν για τις αποφάσεις τους. Εάν οι άνθρωποι δεν λαμβάνουν ουσιαστικές αποφάσεις, τότε δεν μπορούν να θεωρηθούν υπεύθυνοι για τις συνέπειες των πράξεών τους.

Οι πολέμιοι των Killer Robots υποστηρίζουν ότι οι αποφάσεις εν καιρώ πολέμου πρέπει να παραμείνουν στα χέρια των ανθρώπων, καθώς τα αυτόνομα οπλικά συστήματα δεν διαθέτουν την απαραίτητη κρίση για τη διάκριση μεταξύ αμάχων και νόμιμων στρατιωτικών στόχων. Όπως σημειώνει η οργάνωση «Stop Killer Robots», οι μηχανές δεν αναγνωρίζουν τους ανθρώπους ως «ανθρώπους» αλλά ως «δεδομένα» και το γεγονός πως μπορούν να αποφασίζουν αν θα επιτεθούν ή όχι είναι η απόλυτη μορφή ψηφιακής απανθρωποποίησης.

Επίσης η χρήση τους διαστρεβλώνει την πραγματικότητα της φρίκης του πολέμου, καθιστώντας ευκολότερη και πιο αποδεκτή την απόφαση για μια ένοπλη σύρραξη. Η απώλεια ουσιαστικού ανθρώπινου ελέγχου σημαίνει έμμεσα και αδιαφορία για τις συνέπειες των πράξεων και άρα περιορισμό των ηθικών αναστολών και της ηθικής ευθύνης, είτε στο πεδίο της μάχης είτε – για παράδειγμα – σε κάποια διαμαρτυρία. Οι μηχανές δεν μπορούν να κάνουν περίπλοκες ηθικές επιλογές και ούτε μπορούν να κατανοήσουν την αξία της ανθρώπινης ζωής. Τέλος κανείς δεν μπορεί να γνωρίζει τι θα συμβεί αν αυτή η τεχνολογία πέσει σε χέρια τρομοκρατών ή εν γένει εκτός κυβερνητικού ελέγχου.

Μέχρι σήμερα δεν έχει διαμορφωθεί κάποιο πλαίσιο δεσμευτικών κανόνων για τη χρήση τους, ενώ σε πολλές περιπτώσεις οι μεγάλες δυνάμεις αρνούνται πεισματικά τον περιορισμό τους, υποστηρίζοντας πως θα βρεθούν σε μειονεκτική θέση στον πολεμικό ανταγωνισμό. Η λογική είναι απλή: «Χρειαζόμαστε περισσότερα ρομπότ αν οι αντίπαλοι έχουν περισσότερα ρομπότ». Και οι βιομηχανίες όπλων με ενθουσιασμό ενθαρρύνουν αυτή τη νέα κούρσα εξοπλισμών, παράγοντας νέες τεχνολογίες για αυτόνομα οπλικά συστήματα… πιο φονικά, πιο αποτελεσματικά.

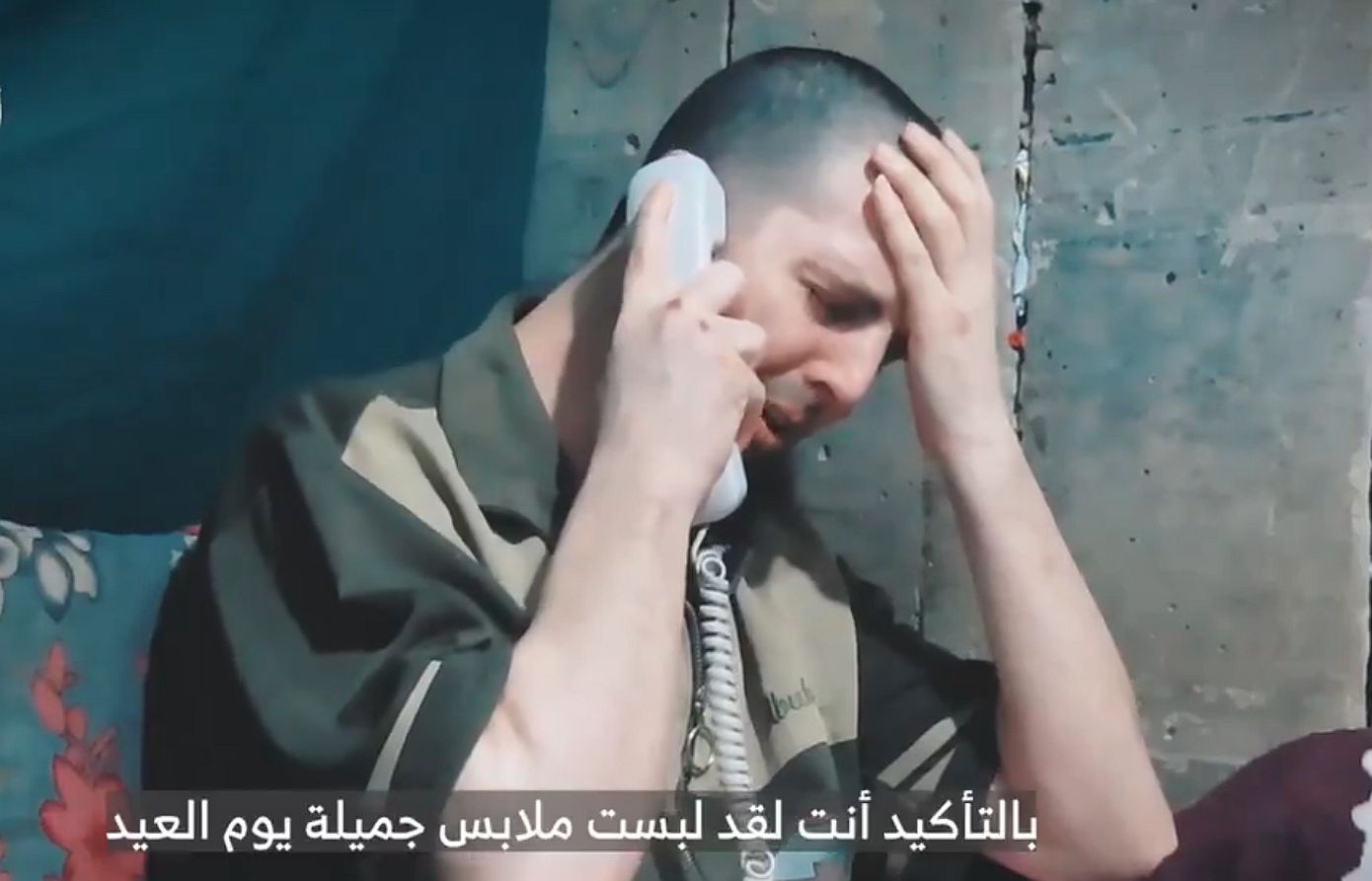

Οι διεθνείς συμφωνίες, όπως οι συμβάσεις της Γενεύης, θεσπίζουν μια σειρά κανόνων για τη μεταχείριση αιχμαλώτων πολέμου και αμάχων κατά τη διάρκεια των συγκρούσεων. Πρόκειται για τα λίγα εργαλεία που υπάρχουν ώστε να ελέγχεται σε κάποιο βαθμό ο τρόπος διεξαγωγής ενός πολέμου, αν και είναι αλήθεια πως έχουν παραβιάστει πολλές φορές μέχρι σήμερα.

«Όμως εάν τα αυτόνομα οπλικά συστήματα κάνουν λάθος και διαπράξουν πιθανώς εγκλήματα πολέμου, ποιος θα αναλάβει την ευθύνη;», διερωτάται η Βανέσσα Βος, ερευνήτρια αυτόνομων όπλων του Πανεπιστημίου της Bundeswehr στο Μόναχο, υπογραμμίζοντας το κενό ευθύνης που υπάρχει. Όπως τονίζει, σύμφωνα με τη Deutsche Welle, ο χρόνος πιέζει παράλληλα με την τεχνολογική πρόοδο που γίνεται επικίνδυνη. «Γι’ αυτό χρειαζόμαστε νέους κανόνες πριν επαληθευθεί το χειρότερο σενάριο».

Μέχρι σήμερα οι εκκλήσεις περί απαγόρευσης δεν βρίσκουν ανταπόκριση και οι επενδύσεις στα αυτόνομα οπλικά συστήματα καλά κρατούν. Τα Killer Robots, η οπλισμένη τεχνητή νοημοσύνη, φαίνεται πως είναι το μέλλον του πολέμου, καθώς οι στρατοί παραδίδουν σταδιακά τα ηνία στους αλγόριθμούς.